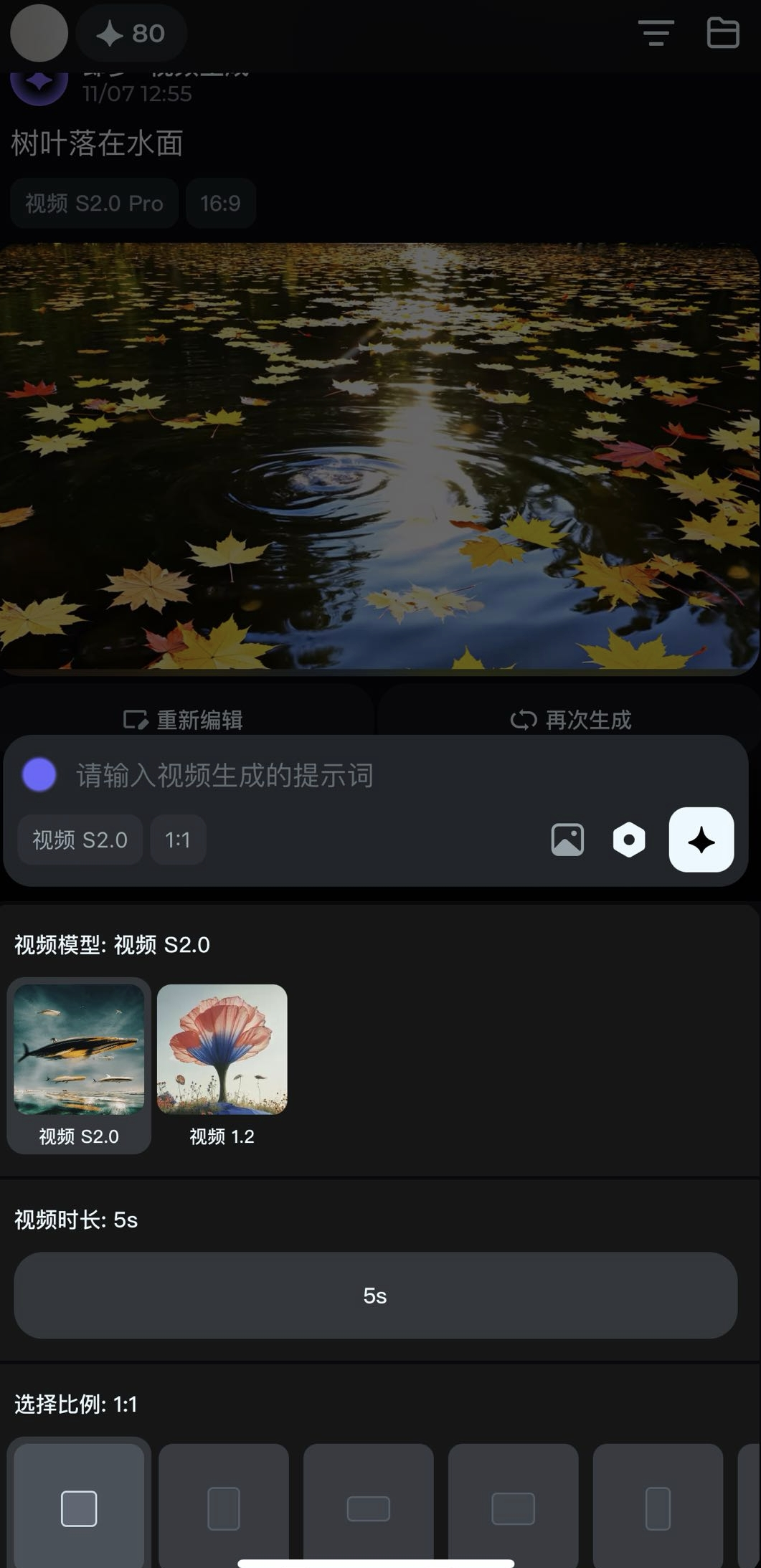

近日,四部门联合印发《人工智能生成合成内容标识办法》(下称《标识办法》),规定人工智能生成合成内容应当添加标识,标识分为以文字、声音、图形等方式呈现并可以被用户明显感知到的显式标识和在文件数据中添加的不易被用户明显感知到的隐式标识。该办法自2025年9月1日起施行。

可看过电视剧《真相捕捉》?是一部讲主人公卷入视频监控伪造的绑架案的悬疑惊悚剧。直播内容可以实时篡改,“眼见为实”打上问号,个体在技术操控面前毫无招架之力。

随着人工智能技术的飞速发展,这部五年前的剧表达的对技术滥用后果的警示和担忧,越来越“写实”。今年1月,西藏日喀则市定日县发生地震,社交媒体上大量传播“小孩被压废墟下”图片,后证实为AI生成;去年美国弗洛里达州被飓风袭击,一个小女孩抱着小狗在救生艇上哭泣的图片,系AI生成;去年10月,“雷军AI配音”视频在网上传播,雷军本人表示,“人工智能技术兴起以后产生了很多新问题,相关部门要提前预判,提前立法。”

人工智能是一把双刃剑。在带来效率提高、技术创新等诸多好处的同时,AI生成技术的滥用、深度伪造等,很可能导致一个真假难辨的世界。一方面,生产制造传播虚假信息的成本和门槛大幅降低,出于娱乐消遣、流量冲动、逐利等各种动机的虚假消息充斥于网络,有研究报告指出,人工智能生成的非法内容数量增多,技术滥用呈现规模化特质。另一方面,用于辨别和核实的成本、时间和资源投入大大增加,真相往往跑不过谣言。

对新技术缺乏了解的人群屡次受骗,容易产生“狼来了”心理效应。真假难辨、信任坍塌,最可怕的后果是真实受到伤害。如果放任灾难事件中类似“被压废墟下小孩”AI生成图片,随意消费、伤害公众的善意和怜悯心,等到真实照片、真实需要急救的场景出现,人们是疑心又一次AI“狼来了”,还是及时出手相助呢?等待的后果是我们能承受的吗?

在这个背景下,根据《互联网信息服务深度合成管理规定》《生成式人工智能服务管理暂行办法》等制定的《标识办法》可谓适时而出。其中第十条明确规定,用户使用网络信息传播服务发布生成合成内容的,应当主动声明并使用服务提供者提供的标识功能进行标识。AI出场即要亮明身份,真实才能更好“生存”。

在“眼见未必为实”的时代,愈发凸显捍卫真实的意义。对普通人而言,要有意识锻炼深度思考能力、提高技术使用能力、提升媒体素养,不用技术成果作恶,不参与生产传播虚假信息。对平台而言,应坚持科技向善,加强技术筛查,发现虚假、有害信息,要按规定作出显著标识、尽快下架等相应处理。对管理者而言,应强化监管,搭建合理有效的监管框架,多方协同、统筹治理发挥效用。(小草)

编辑 王翠